Από την Σωτηρία Δημητροπούλου, ασκούμενη δικηγόρο Αθηνών

Η Τεχνητή Νοημοσύνη (Artificial Intelligence) αποτελεί τη νέα και επαναστατική τεχνολογική πραγματικότητα. Τα επιτεύγματα, που μπορεί να προσφέρει στην επίλυση των καθημερινών προβλημάτων του σύγχρονου κόσμου είναι πολλά. Πολλοί όμως είναι και οι κίνδυνοι που ελλοχεύουν από την ανεξέλεγκτη ανάπτυξη προϊόντων και υπηρεσιών που δημιουργούνται μέσω της τεχνητής νοημοσύνης.

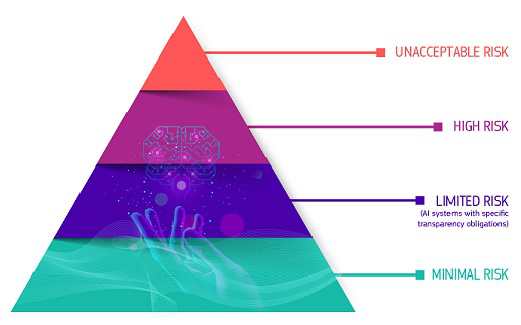

Προς αυτή την κατεύθυνση, τον Απρίλιο του 2021 η Ευρωπαϊκή Επιτροπή κατέθεσε πρόταση για τη δημιουργία ενός Ευρωπαϊκού κανονιστικού πλαισίου για την Τεχνητή Νοημοσύνη (AI). Εφόσον εγκριθεί θα αποτελεί το πρώτο νομοθέτημα σε παγκόσμιο επίπεδο αναφορικά με τη ρύθμιση ζητημάτων AI. Το σχέδιο της Πράξης για την Τεχνητή Νοημοσύνη (AI act) υιοθετεί μία προσέγγιση αναφορικά με τους κινδύνους. Πρόκειται για μία ταξινόμηση των συστημάτων AI ανάλογα με τον κίνδυνο που μπορεί να δημιουργηθεί από αυτά (risk- based approach). Αντιστοίχως δημιουργούνται και ανάλογες υποχρεώσεις. H Πράξης της Ευρωπαϊκής Επιτροπής έχει τροποποιηθεί και το πεδίο εφαρμογής της ταξινόμησης με βάση τον κίνδυνο έχει διευρυνθεί από το Ευρωπαϊκό Συμβούλιο τον Δεκέμβριο του 2022 και από τους Ευρωβουλευτές τον Ιούνιο του 2023.

Ταξινόμηση με βάση τον κίνδυνο (Risk-basedapproach)

Απαράδεκτος κίνδυνος: απαγορευμένες πρακτικές AI

Πρόκειται για πρακτικές που θεωρούνται ως απειλή για την ασφάλεια και τα δικαιώματα των ανθρώπων και συνεπώς θα απαγορεύεται η διάθεση συναφών προϊόντων και υπηρεσιών στην ΕΕ.

Συμπεριλαμβάνονται συστήματα τεχνητής νοημοσύνης που χρησιμοποιούν επιβλαβείς -υποσυνείδητες τεχνικές χειραγώγησης, εκμεταλλεύονται ευάλωτες κοινωνικές ομάδες, χρησιμοποιούνται από δημόσιες αρχές ή για λογαριασμό αυτών για σκοπούς κοινωνικής βαθμολόγησης, δηλαδή ταξινόμηση ατόμων με βάση τη συμπεριφορά και τα προσωπικά χαρακτηριστικά τους, καθώς και συστήματα βιομετρικής αναγνώρισης όπως η αναγνώριση προσώπου.

Υψηλός κίνδυνος: ρυθμιζόμενα συστήματα AI υψηλού κινδύνου

Ρυθμίζονται τα συστήματα τεχνητής νοημοσύνης που δημιουργούν αρνητικό αντίκτυπο στην ασφάλεια και στα θεμελιώδη δικαιώματα των ανθρώπων.

Θα χωρίζονται σε δύο κατηγορίες:

- Συστήματα που χρησιμοποιούνται ως στοιχείο ασφάλειας ενός προϊόντος ή που εμπίπτουν στο πεδίο εφαρμογής των κανόνων υγείας και ασφάλειας της ΕΕ (π.χ. παιχνίδια, αυτοκίνητα, ιατρικές συσκευές)

- Συστήματα τεχνητής νοημοσύνης που εμπίπτουν σε οκτώ συγκεκριμένους τομείς που θα πρέπει να καταχωρηθούν σε μια βάση δεδομένων της ΕΕ, θα υπόκεινται σε κανόνες που συνδέονται με υποχρεώσεις και θα αξιολογούνται πριν διατίθενται στην αγορά:

• βιομετρική ταυτοποίηση και κατηγοριοποίηση φυσικών προσώπων

• διαχείριση και λειτουργία υποδομών ζωτικής σημασίας

• εκπαίδευση και επαγγελματική κατάρτιση

• απασχόληση, διαχείριση εργαζομένων και πρόσβαση στην αυτοαπασχόληση

• πρόσβαση και απόλαυση βασικών ιδιωτικών υπηρεσιών και δημόσιων υπηρεσιών και παροχών

• εφαρμογή του νόμου

• διαχείριση μετανάστευσης, ασύλου και ελέγχου των συνόρων

• απονομή δικαιοσύνης και δημοκρατικές διαδικασίες

Περιορισμένος κίνδυνος: υποχρεώσεις διαφάνειας

Τα συστήματα τεχνητής νοημοσύνης περιορισμένου κινδύνου όπως συστήματα που αλληλοεπιδρούν με τους ανθρώπους (πχ chatbots) και συστήματα αναγνώρισης συναισθημάτων θα πρέπει να συμμορφώνονται με ελάχιστες απαιτήσεις διαφάνειας.

Χαμηλός ή ελάχιστος κίνδυνος: όχι υποχρεώσεις

Τα υπόλοιπα συστήματα AI που παρουσιάζουν χαμηλό ή ελάχιστο κίνδυνο θα μπορούν να αναπτύσσονται χωρίς πρόσθετες νομικές υποχρεώσεις. Βέβαια, στην προτεινόμενη Πράξη προβλέπεται η δημιουργία κωδίκων δεοντολογίας για εκούσια εφαρμογή των υποχρεωτικών απαιτήσεων των συστημάτων ΑΙ υψηλού κινδύνου.

Γενετική Τεχνητή Νοημοσύνη

Προϊόντα Γενετικής Τεχνητής Νοημοσύνης, όπως το ChatGPT, θα πρέπει να συμμορφώνονται με προϋποθέσεις διαφάνειας όπως η αποκάλυψη ότι το περιεχόμενο δημιουργήθηκε από AI και τα μοντέλα θα πρέπει να σχεδιάζονται αποτρέποντας τη δημιουργία παράνομου περιεχομένου.

Επόμενο βήμα για την υιοθέτηση των κανόνων της Πράξης για την Τεχνητή Νοημοσύνη αποτελούν οι διαπραγματεύσεις των Ευρωπαϊκών Χωρών σε επίπεδο Συμβουλίου, ενώ έχει τεθεί ως στόχος να επιτευχθεί συμφωνία μέχρι το τέλος του έτους.

Η νομοθετική αυτή πρωτοβουλία είναι ιδιαίτερα σημαντική και ελπιδοφόρα δεδομένης της ταχείας ανάπτυξης της Τεχνητής Νοημοσύνης. Ο θετικός αντίκτυπος θα φανεί εφόσον εγκριθεί η Πράξη και αποτελείται από αποτελεσματικούς κανόνες, κατάλληλους να εξασφαλίσουν την ασφαλή χρήση προϊόντων τεχνητής νοημοσύνης.

Σε συνεργασία με τον Νομικό Παλμό, αναδημοσίευση: https://nomikospalmos.wordpress.com